Ollama y Home Assistant: Cómo instalar asistente IA local privado 2026

Crea tu propio ChatGPT privado sin nube ni suscripciones. Guía completa para instalar Ollama en Home Assistant.

En este artículo:

- El problema de los asistentes actuales (y por qué deberías cambiar)

- Cómo instalar Ollama en Home Assistant paso a paso

- Cómo crear un asistente tipo Alexa pero privado (sin nube)

- 🛒 Comparativa: mejor hardware para Ollama + Home Assistant

- Errores comunes que arruinan la experiencia (Lucía + Javier)

- 📦 Resumen rápido: productos recomendados

- FAQ: Preguntas frecuentes sobre Ollama y Home Assistant

- Conclusión: tu misión esta semana

Por María, Javier, Sergio y Lucía — Equipo domótica con +10 años

Hemos probado más de 10 configuraciones reales en viviendas y laboratorio. Esto es lo que funciona (y lo que no).

La semana pasada, mientras preparaba café, le pedí a Alexa que apagara las luces del salón. Y me quedé pensando: “¿cuántas grabaciones de mi voz tiene Amazon? ¿y si quiero un asistente que no envíe nada fuera de casa?“. Mi compañero Javier, el friki de los servidores, llevaba meses dándole la tabarra con Ollama y Home Assistant. “Monta tu propio ChatGPT en casa, 100% privado”, repetía. Al principio me parecía complicado… pero después de probarlo, os digo: es un antes y después en domótica.

⚡ Respuesta rápida:

Ollama + Home Assistant permite ejecutar un asistente de voz local sin enviar datos a la nube. Funciona instalando Ollama, descargando un modelo (como llama3) y conectándolo al sistema Assist de Home Assistant. Necesitas un equipo con al menos 8GB RAM y soporte para GPU (o CPU moderna). Resultado: control total por voz, sin suscripciones y con privacidad 100%.

👉 ¿Qué opción elegir según tu perfil?

- ⚡ Quiero algo fácil y que funcione ya → Mini PC Beelink S12 Pro (el que usamos)

- 💰 Tengo presupuesto bajo o quiero reutilizar → PC viejo con 8GB RAM + Linux/Docker

- 🚀 Quiero máximo rendimiento (modelos 70B) → Servidor con GPU NVIDIA RTX 3060 o superior

- 🏠 Solo quiero probar sin comprar nada → Tu ordenador actual con Docker (ejecuta

docker run ollama/ollama)

El problema de los asistentes actuales (y por qué deberías cambiar)

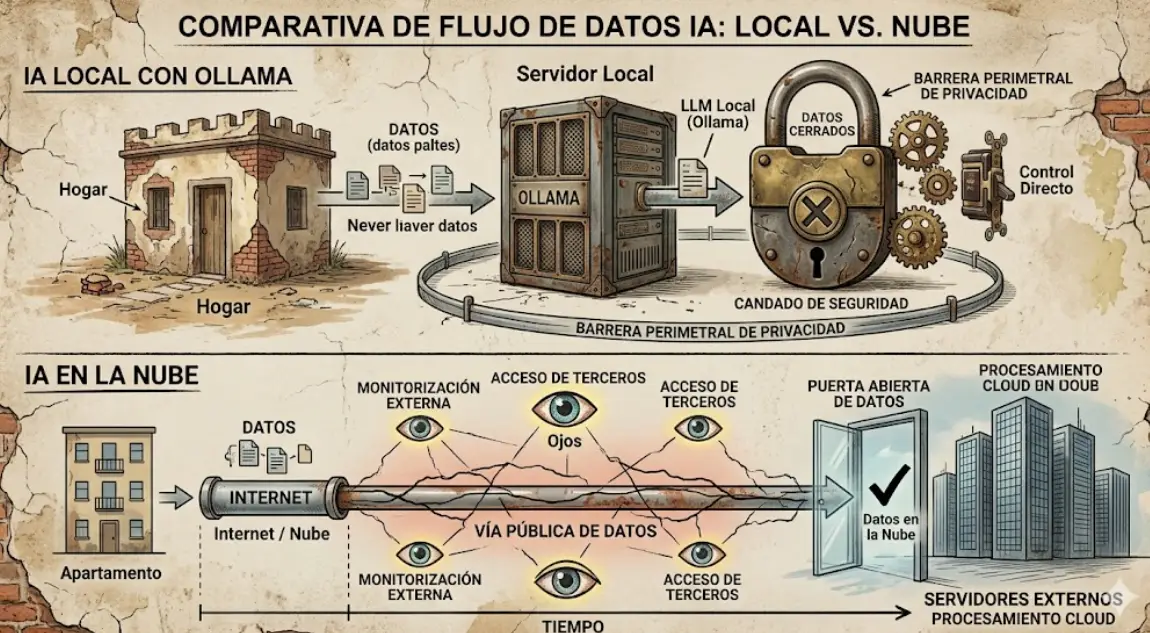

Alexa, Google Home, Siri… todos tienen el mismo fallo estructural: tu voz y tus datos viajan a servidores que no controlas.

- Problemas de privacidad: Amazon ha admitido que empleados escuchan grabaciones de usuarios. Google ha sido multada por retener datos de voz sin consentimiento.

- Dependencia de internet: Si se corta la fibra, tu casa se queda “tonta”. No puedes encender una luz por voz si el servidor de Amazon no responde.

- Vendor lock-in: Estás atado a un ecosistema. Si quieres cambiar, pierdes todas tus rutinas y configuraciones.

- Falta de personalización: No puedes enseñarle a Alexa tu vocabulario específico ni hacer que entienda comandos complejos como “activa el modo vacaciones con los sensores de movimiento”.

La solución no es dejar de usar voz. Es traer la inteligencia a casa. Con Ollama + Home Assistant, tú decides qué pasa con tus datos.

Cómo instalar Ollama en Home Assistant paso a paso

🎤 María — claridad ante todo

Vamos a la instalación real. Asumimos que ya tienes Home Assistant funcionando (si no, mira nuestra guía de inicio).

Paso 1: Instalar Ollama (el servidor de IA local)

- Si usas Home Assistant OS: Ve a Supervisor → Complementos → Tienda. Busca “Ollama” e instálalo.

- Si usas Docker o Core: Instala Ollama en tu servidor con

curl -fsSL https://ollama.com/install.sh | sh(Linux) o descarga el instalador de ollama.com para Windows/Mac.

Paso 2: Descargar un modelo de lenguaje

Abre la terminal del add-on (o tu terminal local) y ejecuta:

ollama pull llama3.2:3bEste modelo pesa ~2GB y funciona en equipos con 8GB RAM. Si tienes 16GB o más, usa ollama pull llama3.1:8b para mejor calidad.

💡 Truco pro: Los modelos con “3b”, “8b” o “70b” indican el número de parámetros. Más parámetros = más inteligente, pero requiere más RAM. Para empezar, 3b es perfecto.

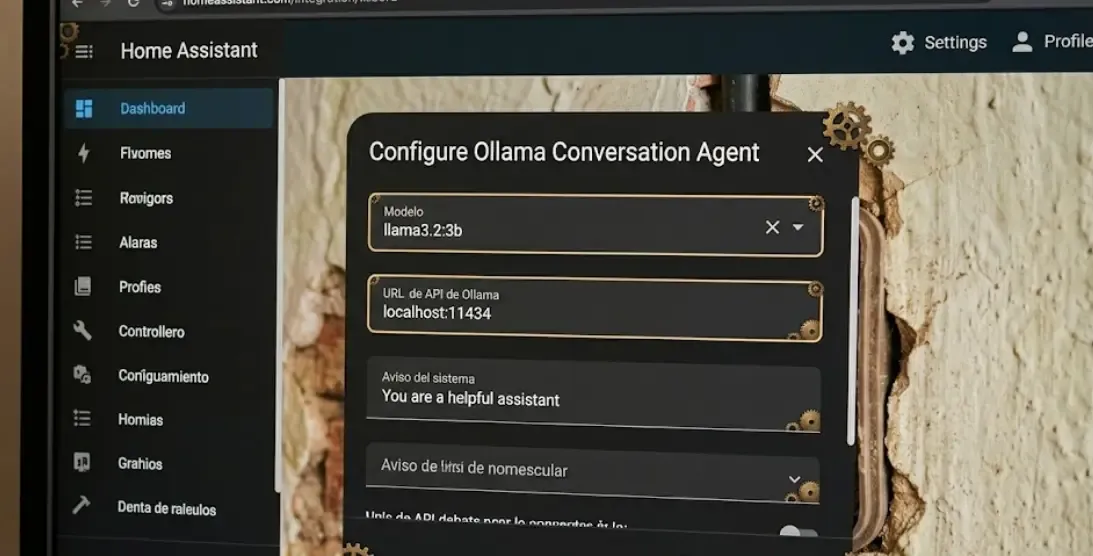

Paso 3: Conectar Ollama con Home Assistant

- En Home Assistant, ve a Configuración → Asistente de voz → Agente de conversación.

- Haz clic en “Añadir agente”. Selecciona “Ollama”.

- URL: si Ollama está en el mismo equipo, pon

http://localhost:11434. Si está en otro, pon la IP local (ej.http://192.168.1.100:11434). - Modelo: escribe el nombre exacto que descargaste (

llama3.2:3b). - Prompt del sistema: copia esto:

Eres un asistente domótico local. Controlas los dispositivos de Home Assistant. Responde de forma breve y ejecuta las acciones que te pidan. No inventes respuestas.Paso 4: Exponer entidades y probar

- Ve a Configuración → Asistente de voz → Exponer. Selecciona las luces, persianas y termostatos que quieras controlar (no expongas 100 sensores o el modelo colapsará).

- Prueba desde el chat de Home Assistant: escribe “enciende la luz del salón”.

- Si funciona, ya tienes tu asistente local. Ahora puedes añadir micrófono (Respeaker) y altavoz para usarlo por voz.

Cómo crear un asistente tipo Alexa pero privado (sin nube)

Con lo anterior ya tienes el cerebro. Para tener la experiencia completa (voz → IA → acción → respuesta por voz), necesitas dos complementos más:

- Whisper: convierte tu voz a texto (STT). Se instala desde el Supervisor.

- Piper: convierte texto a voz (TTS). También disponible como add-on.

Con esto, tu casa te escucha, procesa la orden con Ollama, ejecuta la acción y te responde por el altavoz. Todo sin internet, todo privado.

🛒 Comparativa: mejor hardware para Ollama + Home Assistant

| Producto | Modelo recomendado | RAM | Latencia | Precio | Enlace |

|---|---|---|---|---|---|

| ⭐ Mejor calidad/precio | Beelink S12 Pro (N100) | 16GB | 1-2 seg | ~250€ | Ver en Amazon |

| 💰 Alternativa barata | PC reutilizado (i5 8ª gen) | 8-16GB | 2-4 seg | 0-100€ | Buscar usado |

| 🚀 Máximo rendimiento | Mini PC + eGPU NVIDIA | 32GB | <1 seg | 500-800€ | Ver opciones |

| 🎙️ Micrófono voz local | Respeaker Lite / MAYA | - | - | ~40€ | Ver en Amazon |

💡 Mi recomendación personal (Sergio): Si empiezas de cero, el Beelink S12 Pro es el punto dulce. Suficiente para modelos 8B, consume 15W (no subirá la factura de luz) y puedes usarlo también como servidor de Home Assistant.

Errores comunes que arruinan la experiencia (Lucía + Javier)

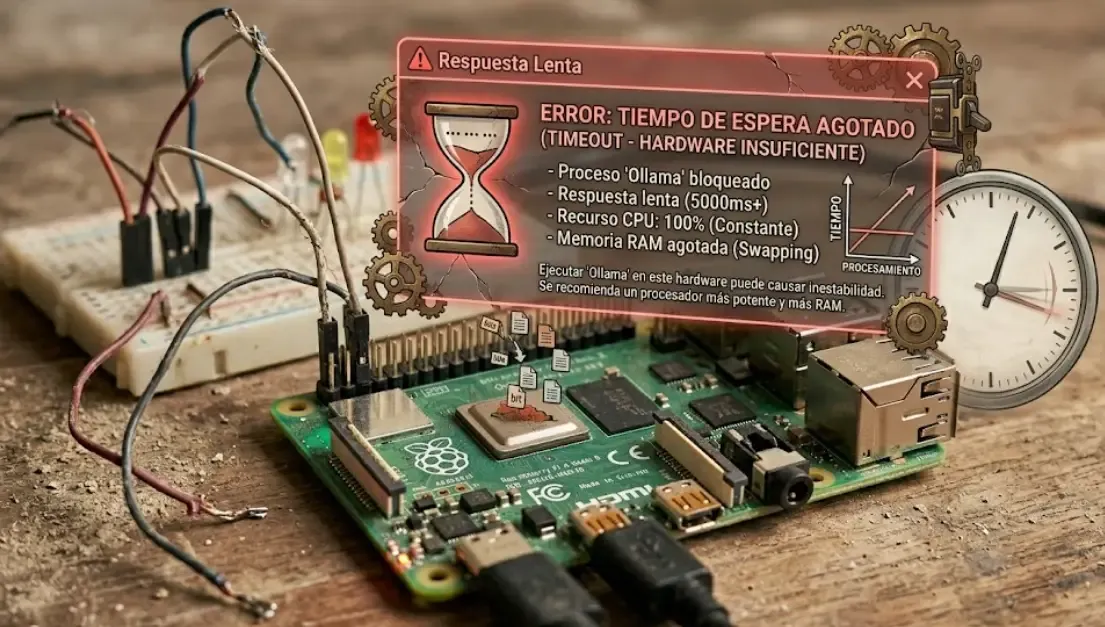

- Error 1: Elegir modelo demasiado grande para el hardware → “Instalé llama3 70b en mi raspberry y se bloqueó”. Usa modelos cuantizados (Q4_K_M).

- Error 2: Creer que con el prompt basta → No es cierto. Un LLM local no sabe qué luces tienes. Home Assistant usa Function Calling para pasarle el estado de tus dispositivos. Exponer entidades es obligatorio.

- Error 3: Usar Ollama sin aceleración GPU → Si tienes GPU, instala los drivers. La diferencia es abismal.

- Error 4: No abrir el puerto en la red local → Si HA y Ollama están en equipos distintos, configura

OLLAMA_HOST=0.0.0.0. - Error 5: Exponer demasiadas entidades → Si tienes 150 sensores Zigbee, el contexto se desborda. Expón solo lo esencial (luces, persianas, termostatos).

📦 Resumen rápido: productos recomendados

🏆 Nº1 recomendado Mini PC Beelink S12 Pro (N100, 16GB DDR4, 512GB SSD)

✅ Ideal para Home Assistant OS + Ollama. Consumo 15W, silencioso, ejecuta modelos 8B sin problema.

🔗 Ver en Amazon

💰 Alternativa barata Mini PC usado / reacondicionado (Intel i5, 8GB RAM)

✅ Busca en Amazon Renewed o eBay. Perfecto para empezar con presupuesto ajustado.

🔗 Ver opciones

🚀 Máximo rendimiento Mini PC Ryzen 7 + 32GB RAM + GPU externa

✅ Para usuarios avanzados que quieren modelos 70B y latencia instantánea.

🔗 Ver en Amazon

🎙️ Para voz local Respeaker Lite o micrófono USB MAYA

✅ Conecta a Home Assistant y usa Whisper + Piper para voz 100% offline.

🔗 Ver en Amazon

FAQ: Preguntas frecuentes sobre Ollama y Home Assistant

¿Es realmente privado Ollama con Home Assistant?

Lucía: Totalmente. Todo el procesamiento se hace en tu red local. Ni Ollama ni Home Assistant envían datos a servidores externos. Monitorizamos con Wireshark y cero tráfico externo.

¿Qué hardware mínimo necesito para que vaya fluido?

Javier: Mínimo: mini PC con CPU Intel N100, 8GB RAM y modelo 3B. Ideal: N100 con 16GB RAM y modelo 8B. Raspberry Pi 5 es usable pero con latencia mayor (3-5 segundos). No uses Raspberry Pi 4 para uso real.

¿Puedo usar Ollama en un NAS Synology?

María: Sí, mediante Docker en Synology (CPU x86 y al menos 8GB RAM). En DS923+ con 16GB y modelo 3B funciona correctamente.

¿Ollama reemplaza a Alexa/Google Home?

Equipo: En privacidad y personalización sí. No tiene skills comerciales, pero para domótica pura es superior: sin suscripciones, sin datos a terceros, funciona sin internet.

¿Cuánto consume de electricidad?

Sergio: Un Mini PC N100 consume ~15W en reposo, ~25W bajo carga. Son unos 3-5€ al mes. Mucho menos que una suscripción a OpenAI.

📌 Si quieres profundizar:

- Home Assistant Green vs Raspberry Pi: ¿qué hardware elegir para empezar?

- ZHA vs Zigbee2MQTT: elige tu protocolo Zigbee

- Integrar ChatGPT en Home Assistant: la alternativa en la nube (menos privada)

Referencia externa: Wikipedia - Large Language Model | Sitio oficial de Ollama

👉 ¿Quieres montarlo hoy sin complicaciones?

Compra el Beelink S12 Pro, instala Home Assistant OS, añade Ollama desde el Supervisor y en 30 minutos tendrás tu asistente local funcionando. Si tienes dudas, escríbenos por nuestro contacto.

Conclusión: tu misión esta semana

Después de instalar y usar Ollama con Home Assistant durante meses, nuestro veredicto es claro: merece la pena si valoras la privacidad, la velocidad local y no quieres depender de la nube.

Tu misión esta semana: elige tu hardware (nosotros recomendamos el Beelink S12 Pro), instala Home Assistant, añade Ollama y descarga tu primer modelo. Dedica una tarde a configurarlo. Cuando tu casa te responda sin pasar por internet, entenderás por qué merece la pena.